Claude CodeのBest Practicesを整理した際に、重要なポイントとして出てきたのが「コンテキストを管理する」という考え方です。

ただ、この「コンテキスト」という言葉は、AIに携わっている方でないと意識している方は少ないかと思います。

コンテキスト自体は、Claude Codeに限らず、AI文脈では一般的な言葉です。

今回は、「コンテキストとは何を指しているのか」と「なぜ管理が必要なのか」を整理していきます。

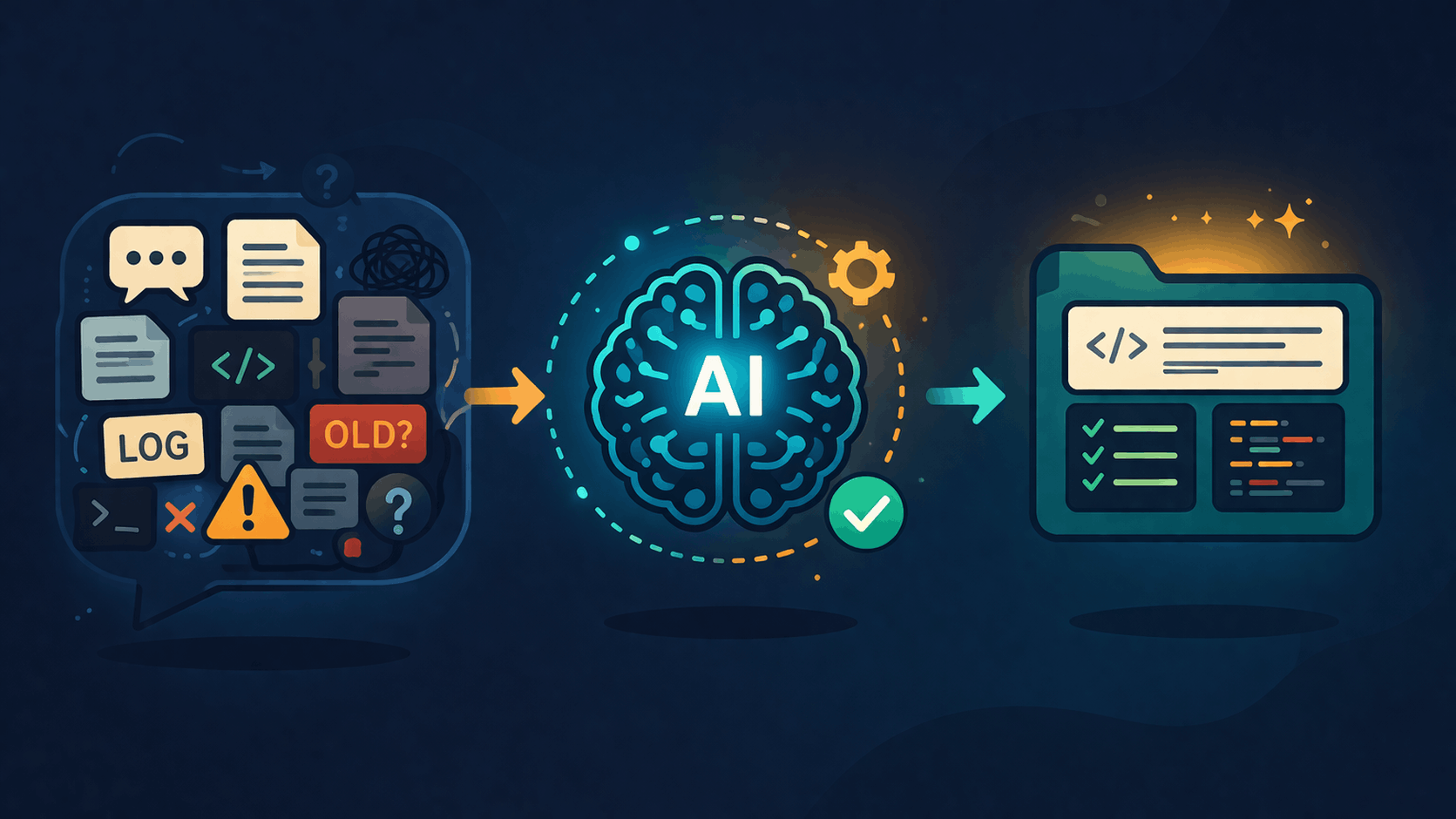

コンテキストとは何か

Claude Codeにおけるコンテキストは、

Claudeがその時点で判断に使っている情報のすべて

を指します。

具体的には、次のようなものが含まれます。

- これまでの会話履歴

- 読み込んだファイルの内容

- 実行したコマンドの出力

- エラーログや標準出力

つまり、Claudeは毎回ゼロから考えているわけではなく、

これまでに見た情報をすべて前提にして次の出力を決めている

という仕組みになっています。

コンテキスト長とは何か

ここで重要になるのが「コンテキスト長」という考え方です。

LLMには、

一度に扱えるテキスト量の上限

があります。

これはモデルごとに決まっており、

- 入力として渡せるテキスト量

- 推論時に考慮できる情報量

の両方を含みます。

例えば、

- 長い会話履歴

- 大量のコードファイル

- 長いログ出力

などを追加していくと、この上限に近づいていきます。

コンテキスト長が長くなるとどうなるか

ここは誤解されやすいポイントですが、

コンテキストは多ければ多いほど良い、というわけではありません。

理論上は、情報が増えるほど判断材料が増えるため精度は上がるはずです。

しかし実務では、

コンテキストが長くなるほど精度は落ちやすい

という挙動になります。

理由は主に3つあります。

ノイズが増える

コンテキストが増えると、

- 関係ある情報

- 関係ない情報

が混ざります。

Claudeはそれらを完全に切り分けられるわけではないため、

無関係な情報も判断材料にしてしまう

ことがあります。

重要な情報の比重が下がる

トークン数が増えると、モデルの中での情報の重みが分散します。

その結果、

本当に重要な情報の影響が弱くなる

という状態が起きます。

古い前提や誤った情報を引きずる

長いセッションでは、

- 試行錯誤の履歴

- 修正前の前提

- 一度間違えた方向

などもコンテキストに残ります。

その結果、

すでに不要な情報を前提に推論してしまう

ことがあります。

Claude Codeで特に起きやすい理由

Claude CodeなどのAIコーディングにおいては、コンテキストが自然に増えていきます。

- ファイルを読む

- コマンドを実行する

- ログを確認する

- 会話を続ける

これらすべてがコンテキストに追加されます。

つまり、

何も意識しないと、コンテキストはどんどん膨らむ構造

になっています。

コンテキストがノイズになるケース

コンテキストは本来、過去の情報を活用するためのものですが、すべての情報が有効とは限りません。

特に次のようなケースでは、ノイズになります。

- 無関係な話題が混ざっている

- すでに不要になった前提が残っている

- 試行錯誤の履歴が積み重なっている

例えば、

実装 → 別の仕様の確認 → 雑談 → バグ修正

といった流れになると、これらすべてがコンテキストに含まれます。

その結果、

本来のタスクに関係ない情報が判断に影響する

状態になります。

コンテキスト管理は「精度管理」

ここまで整理すると、コンテキスト管理は単なる操作ではなく、

AIの精度を保つための管理

だと言えます。

- 必要な情報だけを渡す

- 不要な情報を減らす

これがそのまま出力の質に影響します

まとめ

Claude Codeにおけるコンテキストは、

AIが判断に使っている情報のすべて

を指します。

そしてLLMには、

扱える情報量(コンテキスト長)に制限がある

という前提があります。

そのため、

- 情報が増えすぎると精度が落ちやすい

- 無関係な情報はノイズになる

という特性があります。

精度高くコーディングしてもらうには、必要な情報をきちんと踏まえられるよう、コンテキストの管理がとても重要です。

そのためには、フォルダ構成や CLAUDE.md をどう設計するかを整理し、LLMに適切な情報を渡せる状態を作っておく必要があります。